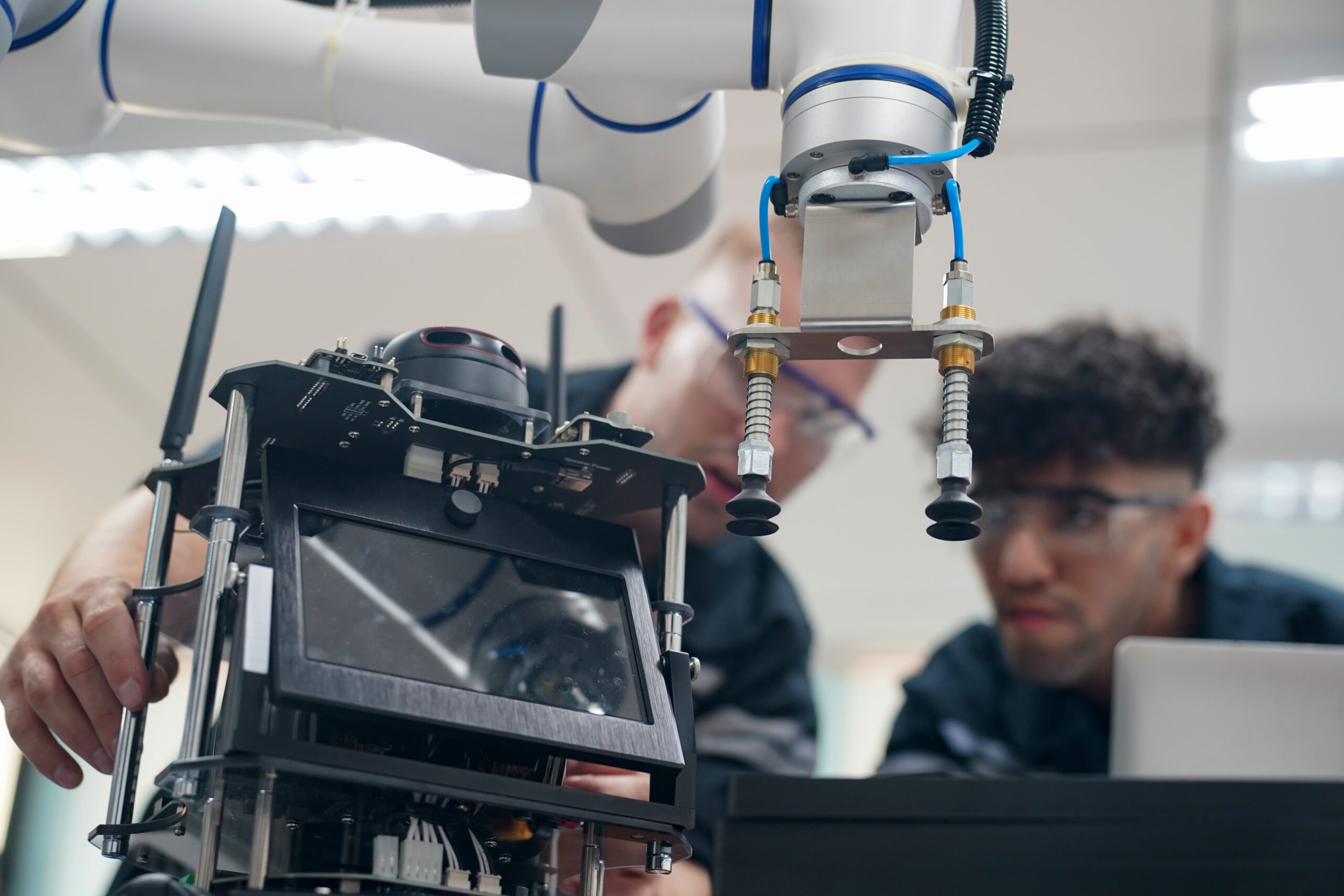

La percepción visual es el núcleo de la robótica moderna. Para que un robot actúe de forma autónoma, necesita ver, interpretar y decidir en tiempo real. A continuación se muestra cómo construir un pipeline de visión robusto para tareas de navegación y manipulación.

Componentes del pipeline

-

Captura de imagen

-

Preprocesamiento

-

Inferencia (SLAM, detección, clasificación)

-

Publicación de datos

-

Actuación / control

Cámaras y sincronización

Recomendaciones:

-

Cámaras global shutter para movimiento

-

Sincronización con IMU para SLAM

-

FPS ≥ 30 para navegación reactiva

-

Exposición adaptativa en ambientes variables

Modelo de visión

import torch

from torchvision import modelsmodel.eval()

En robótica, optimizar el modelo es tan importante como la arquitectura.

Integración en tiempo real

-

Nodos específicos para percepción

-

Zero-copy transport en ROS2

-

Aceleradores: GPU / TensorRT / EdgeTPU

-

Monitorización de latencia (<100 ms ideal)

Validación

| Métrica | Objetivo |

|---|---|

| Latencia | < 100 ms |

| Precision | Dependiente de tarea |

| Robustez | Iluminación / ruido / movimiento |

Simulación + pruebas reales = robots fiables

Conclusión

Un buen pipeline de visión no es solo AI: incluye cámaras adecuadas, sincronización precisa y optimización en tiempo real.